Geleneksel bilgelik şöyle der: "Verilerinizin kullanılmasını istemiyorsanız, her şeyden çekilin."

Biz şunu söylüyoruz: "Verileriniz zaten toplanıyorsa, bunların nasıl kullanıldığını etkilemek daha mantıklıdır."

"Şirketler benim verilerime sahip olmalı mı?" değil (zaten sahipler).

Asıl soru şudur: "Verilerim herkes için daha iyi bir yapay zeka oluşturulmasına katkıda bulunmalı mı?"

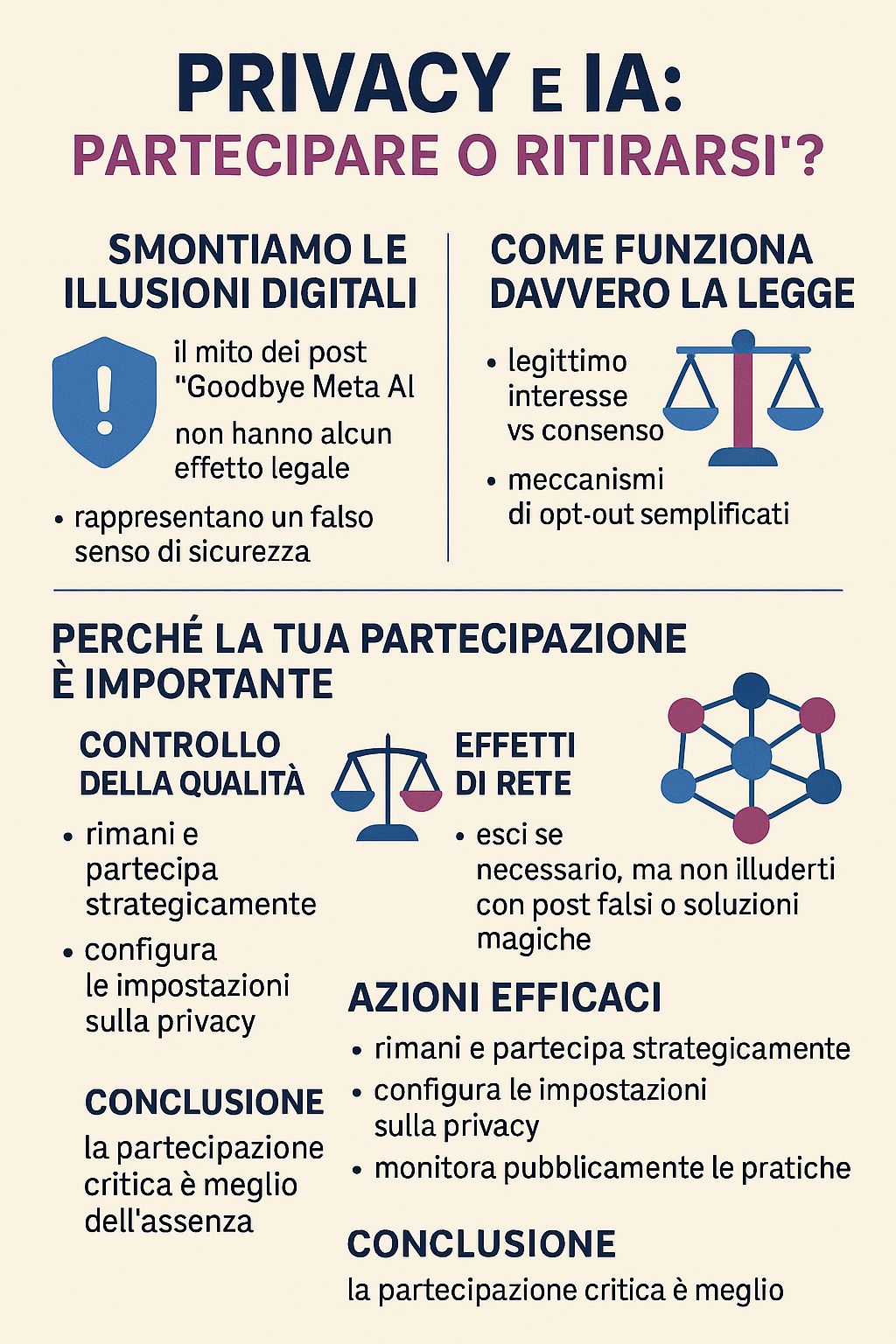

Ciddi bir argüman oluşturmadan önce, sosyal medyada dolaşan tehlikeli bir yanılgıyı ortadan kaldırmak çok önemlidir: Bir mesaj paylaşarak verilerinizi koruyacağını vaat eden "Goodbye Meta AI" adlı viral paylaşımlar.

Rahatsız edici gerçek: Bu gönderiler tamamen sahte ve sizi daha savunmasız hale getirebilir.

Meta'nın kendisi de açıkladığı gibi, "Goodbye Meta AI" mesajını paylaşmak geçerli bir muhalefet biçimi değildir. Bu gönderiler:

Bu gönderilerin viral olarak yayılması, daha derin bir sorunu ortaya koyuyor: Karmaşık ve bilinçli kararlar yerine basit ve yanıltıcı çözümleri tercih ediyoruz. Bir gönderiyi paylaşmak, dijital haklarımızın nasıl işlediğini gerçekten anlamaya çalışmak zorunda kalmadan aktif olduğumuzu hissettiriyor.

Ancak mahremiyet memlerle korunamaz. Bilgi ve bilinçli eylemlerle korunur.

31 Mayıs 2025 tarihinden itibaren Meta, rıza yerine "meşru menfaat" i yasal dayanak olarak kullanarak yapay zeka eğitimi için yeni bir rejim uygulamaya koydu. Bu bir kaçış yolu değil, GDPR'da öngörülen yasal bir araçtır.

Meşru menfaat, şirketlerin, menfaatlerinin kullanıcı haklarından üstün olmadığını kanıtlayabilmeleri halinde, açık rıza olmaksızın verileri işlemeyi mümkün kılar. Bu durum, şirketlerin iç değerlendirmeler yoluyla "yasayı kendilerine göre ayarladıkları" bir gri alan yaratır.

Anonimleştirilmemiş verilerin kullanılması, "model tersine çevirme, hafızada kalma sızıntıları ve çıkarma güvenlik açıkları" gibi yüksek riskler içerir. Gerekli olan hesaplama gücü, yalnızca çok yüksek kapasiteye sahip aktörlerin bu verileri etkili bir şekilde kullanabileceği anlamına gelir ve bu da vatandaşlar ile büyük şirketler arasında sistemik asimetriler yaratır.

Yasal ve teknik gerçekleri açıklığa kavuşturduktan sonra, stratejik katılım için argümanımızı oluşturalım.

Bilinçli insanlar vazgeçtiğinde, yapay zeka kalanlar üzerinde çalışır. Yapay zeka sistemlerinin esas olarak aşağıdaki kişilerin verilerine dayanmasını ister misiniz?

AI'da önyargılar, eğitim verilerinin temsil edici olmadığı durumlarda ortaya çıkar. Katılımınız aşağıdakileri sağlamaya yardımcı olur:

AI sistemleri ölçek ve çeşitlilikle birlikte gelişir:

AI tabanlı özellikleri (arama, çeviri, öneriler, erişilebilirlik araçları) kullanıyorsanız, katılımınız bu özelliklerin herkes için, özellikle de en çok ihtiyaç duyan gelecekteki kullanıcılar için iyileştirilmesine katkıda bulunur.

AI için opt-in ve opt-out arasında gizliliğinizde önemli bir değişiklik olmaz. Aynı veriler zaten şu kaynaklara aktarılmaktadır:

Fark, bu verilerin herkes için yapay zekayı iyileştirmeye de katkıda bulunup bulunmadığı ya da sadece platformun acil ticari çıkarlarına hizmet edip etmediği.

İşte bu yüzden senin gibi sorumlu insanlar bu sürece katılmalıdır. Geri çekilmek, yapay zekanın gelişimini durdurmaz, sadece senin sesini bu süreçten uzaklaştırır.

AI sistemleri her halükarda geliştirilecektir. Asıl soru şu: Bu konularda eleştirel düşünen insanların katkısıyla mı, yoksa katkısı olmadan mı?

Anlaşılabilir bir durum. Ancak şunu bir düşünün: AI sistemlerinin, büyük şirketlere karşı sizinle aynı şüpheci yaklaşımı paylaşan kişilerin katkısıyla mı, yoksa katkısı olmadan mı geliştirilmesini tercih edersiniz?

Güvensizliğin, eleştirel katılımının değerli olmasının sebebidir.

Yapay zeka, siz katılsanız da katılmasanız da gerçeğe dönüşüyor.

Seçiminiz, AI'nın geliştirilip geliştirilmeyeceği değil, geliştirilecek AI'nın bu konuları dikkatle düşünen insanların değerlerini ve bakış açılarını yansıtıp yansıtmayacağıdır.

Opt-out yapmak oy kullanmamak gibidir. Seçimleri durdurmaz, sadece sonucun sizin katkınızı dikkate almayacağı anlamına gelir.

Yüksek hesaplama kapasitesine sahip aktörlerin bu verileri etkili bir şekilde yorumlayıp kullanabildiği bir dünyada, eğitimde eleştirel sesiniz, yokluğunuzdan daha fazla etki yaratabilir.

Aşağıdaki durumlarda kalın ve stratejik olarak katılın:

Ve bu arada:

Ama şununla kendini kandırma:

Bireysel olarak vazgeçmeniz gizliliğinizi çok az etkiler, ancak kalmanız herkesi gerçekten etkiler.

AI sistemlerinin bilgi akışını, kararları ve insanlar ile teknoloji arasındaki etkileşimleri belirleyeceği bir dünyada, mesele bu sistemlerin var olup olmaması değil, sizin gibi düşünceli ve eleştirel insanların bakış açısını da içermesi gerektiğidir.

Bazen en radikal eylem vazgeçmek değildir. Çoğu zaman en radikal yol kalmak ve sesinizin duyulmasını sağlamaktır.

Anonim

Bu, şirketlere körü körüne güvenmek veya gizlilikle ilgili endişeleri görmezden gelmek anlamına gelmez. Bu, gizliliğin memlerle değil, stratejik ve bilinçli katılımla savunulabileceğini kabul etmek anlamına gelir.

Güç dengesizliklerinin çok büyük olduğu bir ekosistemde, yapay zeka eğitiminde eleştirel sesiniz, protesto etmek için yokluğunuzdan daha fazla etki yaratabilir.

Seçimin ne olursa olsun, bilinçli bir şekilde seç, dijital illüzyonlarla değil.

"Gizlilik münzevi" lere de sempati duyduğumuzu belirtmek isteriz - 2025 yılında Tibet rahipleri gibi çevrimdışı yaşayarak dijital izlenmeden tamamen kaçabileceklerine inanan saf ruhlar.

Spoiler: Dolomiti'de ıssız bir kulübede yaşamaya başlasanız bile, verileriniz zaten her yerde. Aile hekiminiz dijital sistemler kullanıyor. Yakacak odun satın almak için biriktirdiğiniz parayı tuttuğunuz banka her işlemi takip ediyor. Köydeki süpermarket kameralar ve elektronik ödeme sistemleri kullanıyor. Faturalarınızı getiren postacı bile, optimizasyon algoritmalarını besleyen lojistik veri setlerine katkıda bulunuyor.

2025 yılında tamamen dijital inzivaya çekilmek, esasen sivil toplumdan kendini dışlamak anlamına geliyor. Instagram'ı bırakabilirsiniz, ancak sağlık, bankacılık, eğitim veya iş sistemini bırakamazsınız, aksi takdirde yaşam kaliteniz üzerinde dramatik sonuçlar doğar.

Ve siz 5G'ye karşı kulübenizi inşa ederken, verileriniz hastanelerin, bankaların, sigorta şirketlerinin, belediyelerin, vergi dairelerinin veritabanlarında var olmaya devam ediyor ve yine de gelecek nesilleri etkileyecek sistemleri eğitmek için kullanılıyor.

Keşiş paradoksu: Protestocu izolasyonunuz, AI sistemlerinin daha az bilinçli kişilerin verileriyle eğitilmesini engellemez, ancak sizi bu sistemlerin daha etik yönlere doğru gelişmesini etkileme olanağından mahrum bırakır.

Esasen, tribünlerden tarihi izleyenlerin saf ahlaki saflığını kazandın, diğerleri ise - daha az aydınlanmış ama daha fazla varlık gösterenler - oyunun kurallarını yazıyorlar.

Seçimin ne olursa olsun, bilinçli bir şekilde seç, dijital illüzyonlarla değil.

Alıntı yapılan makaleler:

GDPR ve meşru menfaat hakkında ayrıntılı bilgiler:

Resmi kaynaklar:

Somut adımlar için: Avrupa'da bulunuyorsanız, resmi opt-out prosedürlerini Gizlilik Kurumuna danışın. Genel bilgiler için, platformunuzun gizlilik ayarlarını ve hizmet şartlarını inceleyin. Unutmayın: sosyal medyadaki hiçbir gönderi yasal geçerliliğe sahip değildir.